Das Wichtigste in Kürze

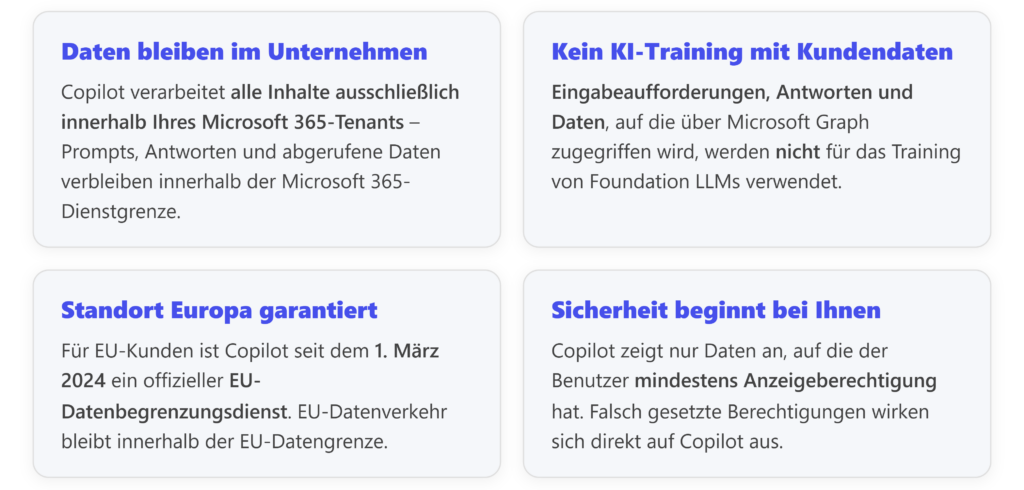

Microsoft 365 Copilot ist ein KI Assistent, der große Sprachmodelle (LLMs) mit den Inhalten Ihres Microsoft 365 Tenants verbindet. E-Mails, Dokumente, Kalender, Chats und Besprechungen, auf die der jeweilige Nutzer Zugriff hat. Alle Prompts, abgerufenen Daten und generierten Antworten verbleiben dabei innerhalb der Microsoft 365-Dienstgrenze. Für die KI Verarbeitung nutzt Copilot Azure OpenAI Services, nicht die öffentlich verfügbaren OpenAI Services und Azure OpenAI speichert keine Kundeninhalte zwischen. Microsoft bestätigt ausdrücklich: Eingabeaufforderungen, Antworten und Graph-Daten werden nicht für das Training von Foundation LLMs verwendet. Copilot entspricht den bestehenden Datenschutz-, Sicherheits- und Compliance-Verpflichtungen gegenüber kommerziellen Microsoft 365-Kunden, einschließlich der DSGVO und der EU-Datengrenze. Gleichzeitig gilt ein zentrales Prinzip: Copilot übernimmt Ihre bestehenden Sicherheitseinstellungen, er verstärkt sie aber nicht automatisch.

Datenverarbeitung: Wo bleiben Ihre Daten?

Tenant-Isolation und Verarbeitung

Copilot greift über den Microsoft Graph auf Organisationsdaten zu und kombiniert diese mit dem Arbeitskontext des Benutzers, z. B. aktuelle Besprechungen, E-Mail-Verläufe oder Chatkonversationen der letzten Tage. Die dabei entstehenden Prompts und Antworten bleiben vollständig innerhalb der Microsoft 365 Dienstgrenze. Gespeicherte Interaktionsdaten (Prompts und Copilot-Antworten einschließlich Quellenverweise) werden verschlüsselt gespeichert und nicht zum Trainieren grundlegender LLMs verwendet. Die Missbrauchsüberwachung mit menschlicher Inhaltsüberprüfung, die in Azure OpenAI grundsätzlich verfügbar ist, wurde für Microsoft 365 Copilot Dienste deaktiviert – ein weiterer Schutz gegen unerwünschte Einsichtnahme Dritter.

Administratoren können die gespeicherten Interaktionsdaten über Inhaltssuche oder Microsoft Purview einsehen und verwalten, Aufbewahrungsrichtlinien festlegen und bei Bedarf Daten über die Microsoft Teams-Export-APIs exportieren. Nutzer selbst können ihren Copilot Aktivitätsverlauf über das Portal „Mein Konto“ löschen.

Wichtiger Hinweis zur Copilot-Version: Die oben genannten Schutzmaßnahmen gelten für Microsoft 365 Copilot (Business & Enterprise). Davon zu unterscheiden ist die kostenfreie Copilot Chat Version. Diese hat keinen Zugriff auf Unternehmensdaten und dient ausschließlich als reiner KI Chat auf Basis von öffentlich verarbeiteten Prompts.

DSGVO-Konformität und EU Data Boundary

Microsoft 365 Copilot wurde am 1. März 2024 als abgedeckte Workload in die Datenresidenzverpflichtungen der Microsoft Produktbedingungen aufgenommen. Für EU-Kunden ist Copilot ein EU-Datenbegrenzungsdienst: Der EU-Datenverkehr bleibt innerhalb der EU-Datengrenze. LLM-Anfragen werden an die nächstgelegenen Rechenzentren in der Region weitergeleitet; bei hoher Auslastung können sie in andere Regionen mit verfügbarer Kapazität umgeleitet werden, wobei EU-Datenverkehr dennoch innerhalb der EU-Datengrenze verbleibt. Kunden außerhalb der EU können ihre Abfragen in den USA, der EU oder anderen Regionen verarbeiten lassen.

Die Angebote Microsoft Advanced Data Residency (ADR) und Multi-Geo Capabilities umfassen seit dem 1. März 2024 ebenfalls Datenresidenzverpflichtungen für Copilot-Kunden.

Zugriff nur mit Berechtigung: Rollen- und Berechtigungskonzepte

Copilot zeigt ausschließlich Organisationsdaten an, für die der einzelne Benutzer mindestens die Anzeigeberechtigung besitzt, und verwendet dieselben Zugriffssteuerungen wie andere Microsoft 365 Dienste. Das schließt auch Berechtigungen ein, die Benutzern außerhalb der Organisation erteilt wurden, z. B. über freigegebene Kanäle in Microsoft Teams.

Das größte Risiko dabei: Übermäßig breite Berechtigungen (Over-Permissioning). Fehlkonfigurierte Freigabeeinstellungen, geerbte Zugriffsrechte oder veraltete Sharing-Links ermöglichen es Copilot, vertrauliche Daten an Benutzer zurückzugeben, die diese nie sehen sollten. Regelmäßige Berechtigungsüberprüfungen und die konsequente Umsetzung des Least-Privilege-Prinzips sind daher unverzichtbar.

Praxis-Beispiel: Ein SharePoint-Ordner mit Vertragsdaten wurde versehentlich unternehmensweit freigegeben. Fragt ein Mitarbeiter Copilot nach laufenden Verträgen, kann Copilot diesen Ordner auswerten – nicht weil die KI Grenzen umgeht, sondern weil die Berechtigung es zulässt. Solche Szenarien verdeutlichen, warum eine Bereinigung vorhandener Berechtigungsstrukturen vor der Copilot-Einführung essenziell ist.

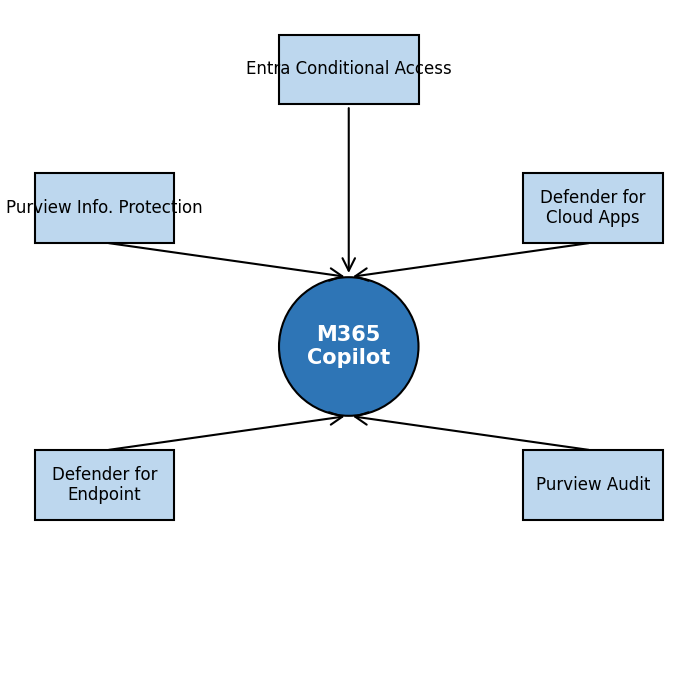

Sicherheitsbausteine zur Absicherung der Copilot Umgebung

Microsoft liefert mit Copilot integrierte Schutzmechanismen:

| Tool/Service | Zweck & Fähigkeit | Nutzen für Copilot-Sicherheit | Risiko ohne dieses Tool |

|---|---|---|---|

| Microsoft Purview Information Protection (Klassifizierung & Sensitivity Labels) | Sensible Daten klassifizieren, mit Vertraulichkeitsbezeichnungen & Verschlüsselung schützen. | Copilot erkennt Labels und gibt geschützte Daten nur zurück, wenn der Benutzer das EXTRACT-Nutzungsrecht und VIEW besitzt. Labels werden in Copilot-Antworten angezeigt und bei neuen Dokumenten automatisch vererbt. | Vertrauliche Informationen können ohne Kennzeichnung unbemerkt in Copilot Antworten einfließen. Kein automatischer Schutz sensibler Inhalte. |

| Microsoft Defender for Cloud Apps (CASB für Cloud-Anwendungen) | Cloud Nutzung & Schatten-IT erkennen; Richtlinien für generative KI Apps durchsetzen. | Erkennt nicht genehmigte KI-Apps über den Cloud-App-Katalog mit Kategorie „Generative AI“ und Risikoscores. Als „Unsanctioned“ markierte Apps werden automatisch auf allen Defender-for-Endpoint-Geräten blockiert. | Mitarbeiter nutzen eigenständig externe KI-Tools mit Firmendaten (Shadow AI). Kein Einblick in unkontrollierte Datenabflüsse. |

| Microsoft Entra Conditional Access (Bedingter Zugangsschutz) | Zugriffsbedingungen steuern: Wer darf wann, von wo und womit auf Copilot zugreifen. | Erzwingt MFA, validiert Benutzerkontext und blockiert riskante Anmeldungen, bevor Copilot eine Abfrage verarbeitet. Ermöglicht Einschränkung auf verwaltete Geräte, Standorte oder Risikostufen. | Jeder berechtigte Account kann von überall auf Copilot zugreifen. Gestohlene Anmeldeinformationen oder unsichere BYOD-Geräte erhöhen das Kompromittierungsrisiko. |

| Microsoft Defender for Endpoint (Endgerätesicherheit) | Geräte auf Kompromittierung überwachen; Malware & Angriffe abwehren; unsanktionierte KI-Apps blockieren. | Erkennt kompromittierte Geräte und kann automatisiert isolieren. Verhindert, dass unsanktionierte KI-Apps auf ongeboardeten Geräten laufen (Integration mit Cloud Apps). | Infizierte Endgeräte können Copilot Eingaben und Antworten abgreifen. Unsanktionierte Apps laufen ungehindert weiter. |

| Microsoft Purview Audit (Protokollierung & Monitoring) | Umfassende Audit Logs aller Copilot Aktivitäten, Dateizugriffe und angewandter Labels. | Prompts und Antworten werden im einheitlichen Überwachungsprotokoll erfasst. Inklusive Zeitstempel, M365 Dienst und referenzierter Dateien. Wenn Dateien Sensitivity Labels tragen, wird dies ebenfalls protokolliert. Ergebnisse fließen in den Aktivitäts-Explorer in DSPM für KI. | Copilot Aktivitäten bleiben intransparent. Im Compliance Fall fehlt die Nachvollziehbarkeit – kritisch bei Datenschutzprüfungen. |

Abb. 1: Mehrschichtiger Sicherheitsansatz – Microsoft 365 Copilot operiert innerhalb des Unternehmens-Tenants und wird von verschiedenen Sicherheits- und Compliance-Layern geschützt

Microsoft Purview Information Protection im Detail

Sensitivity Labels bilden eine zusätzliche Schutzebene über die Zugriffssteuerung hinaus: KI-Apps, die Microsoft Purview unterstützen, stellen sicher, dass im Tenant gespeicherte Daten niemals an den Benutzer zurückgegeben oder von einem LLM verwendet werden, wenn der Benutzer keinen Zugriff hat. Wenn Labels Verschlüsselung erzwingen, benötigt der Benutzer das EXTRACT-Nutzungsrecht zusätzlich zu VIEW, damit Copilot die Daten verwenden darf. Dieser Schutz erstreckt sich auch auf Daten außerhalb des Microsoft 365-Tenants, solange sie in einer Office-App geöffnet sind (z. B. lokaler Speicher, Netzwerkfreigaben).

Copilot Chat zeigt die Vertraulichkeitsbezeichnung mit der höchsten Prioritätsnummer aus den verwendeten Datenquellen an. Das sensibilisiert Nutzer direkt für die Vertraulichkeit der Inhalte. Bei der Erstellung neuer Dokumente in Word, PowerPoint oder Outlook wird das Label der Quelldatei automatisch vererbt – inklusive Schutzeinstellungen.

Purview unterstützt insgesamt 11 Funktionsbereiche für Copilot-Interaktionen, darunter DSPM für KI, Auditing, Datenklassifizierung, Sensitivity Labels, Verschlüsselung, DLP, Insider Risk Management, Kommunikations-Compliance, eDiscovery, Datenlebenszyklusverwaltung und Compliance Manager – jeweils mit vollständiger Unterstützung für KI-Interaktionen.

Microsoft Defender for Cloud Apps im Detail

Microsoft 365 enthält mit Microsoft Defender for Office 365 leistungsstarke Schutzmechanismen gegen Defender for Cloud Apps ermöglicht über den Cloud-App Katalog die gezielte Erkennung generativer KI-Anwendungen. Durch Filterung nach der Kategorie „Generative AI“ sehen Administratoren eine Liste genutzter KI-Apps mit zugehörigen Sicherheits- und Compliance Risikoscores. Darauf aufbauend lassen sich Überwachungsrichtlinien erstellen, die bei Erkennung neuer generativer KI-Apps automatisch Alarme auslösen. Alternativ können bestimmte Apps als „Unsanctioned“ markiert werden – in diesem Fall blockiert Defender for Endpoint den Zugriff automatisch auf allen angebundenen Geräten oder blendet eine Warnung ein.

Für die Nutzung von Defender for Cloud Apps wird die Einrichtung von Microsoft Defender XDR mit den Komponenten Defender for Cloud Apps und Defender for Endpoint empfohlen.

Microsoft Entra Conditional Access im Detail

Conditional-Access-Richtlinien ermöglichen die kontextbasierte Steuerung des Copilot-Zugriffs. In Kombination mit Entra ID Identity Protection-Signalen werden riskante Anmeldungen erkannt, MFA erzwungen und der Zugriff bei Bedarf vollständig blockiert. Typische Szenarien umfassen: Beschränkung auf verwaltete Geräte, Standortbegrenzung auf das Firmennetzwerk oder risikobasierte Eskalation bei kompromittierten Konten.

Microsoft Defender for Endpoint im Detail

Copilot interagiert letztlich auf dem Endgerät des Nutzers. Defender for Endpoint schützt diese Frontlinie mit EDR- und XDR-Funktionen und stellt durch die Integration mit Cloud Apps sicher, dass unsanktionierte KI-Anwendungen nicht auf firmeneigenen Geräten ausgeführt werden. Erkennt Defender eine Kompromittierung, kann das Gerät automatisiert isoliert werden – bevor über dieses Gerät sensible Copilot-Anfragen gestellt werden.

Microsoft Purview Audit im Detail

Alle Copilot-Interaktionen werden im einheitlichen Überwachungsprotokoll erfasst. Ereignisse dokumentieren, wie und wann Benutzer mit der KI interagieren, in welchem Microsoft 365 Dienst die Aktivität stattfand, und enthalten Verweise auf die in Microsoft 365 gespeicherten Dateien, auf die während der Interaktion zugegriffen wurde. Wenn diese Dateien eine Vertraulichkeitsbezeichnung tragen, wird diese ebenfalls erfasst. Die Ereignisse fließen in den Aktivitäts-Explorer innerhalb von DSPM für KI, wo Prompt- und Antwortdaten angezeigt werden können. Ergänzend steht die Überwachungslösung im Microsoft Purview-Portal zur Verfügung.

Darüber hinaus bietet DSPM für KI (Data Security Posture Management) eine zentrale Oberfläche mit Datenrisikobewertungen, die Oversharing-Probleme identifizieren, sowie 1-Klick-Richtlinien für Vertraulichkeitsbezeichnungen, die Erkennung riskanter KI-Nutzung und den Schutz vertraulicher Daten vor Copilot- und Agent-Verarbeitung.

Verantwortlichkeiten und organisatorische Voraussetzungen

Shared Responsibility: Was Microsoft liefert und was bei Ihnen liegt

Microsoft stellt mit Microsoft 365 Copilot einen DSGVO‑konformen Cloud‑Dienst bereit. Der Schutz der Plattform umfasst unter anderem:

- Absicherung der Microsoft Infrastruktur

- Verschlüsselung von Daten

- Mandantenisolation

- Native Sicherheitskontrollen

- Responsible‑AI‑Filter

- Inhaltsblockierung und Schutz vor Jailbreak‑Versuchen

Die Verantwortung für die korrekte Nutzung liegt jedoch bei der Organisation selbst. Dazu zählen insbesondere:

- Saubere und restriktive Berechtigungsstrukturen

- Korrekte Vergabe von Sensitivitätslabels

- Definition und Durchsetzung von Conditional‑Access‑Richtlinien

- Auswertung von Audit‑Logs und Sicherheitsereignissen

Ohne diese organisatorischen und technischen Ergänzungen reichen die nativen Sicherheitsmechanismen allein nicht aus, um Risiken wie Oversharing oder eine unkontrollierte Nutzung von KI‑Tools im Unternehmen zu verhindern.

Governance und Copilot Readiness

Unternehmen sollten vor dem Rollout folgende Maßnahmen umsetzen:

- Datenschutz-Folgenabschätzung (DSFA, Art. 35 DSGVO) für KI-Prozesse und Copilot-Einsatzbereiche durchführen – insbesondere angesichts der Anthropic-Unterauftragsverarbeitung, die nicht der EU-Datengrenze unterliegt

- Berechtigungsstrukturen bereinigen: Veraltete Freigaben entfernen und das Least-Privilege-Prinzip konsequent durchsetzen

- Datenschutzbeauftragte und Compliance-Teams frühzeitig einbeziehen

- Sensitivitätslabels und Informationsbarrieren konfigurieren, bevor Copilot aktiviert wird

- Richtlinien für Löschkonzepte, Archivierung und DLP definieren

- Audit-Logs und Security-Alerts in Purview Compliance Manager und Microsoft Defender aktivieren

- Unternehmensrichtlinie zum KI-Einsatz erstellen – die EU-KI-Verordnung verlangt klare Regeln für den Umgang mit KI-Systemen

- Schulung der Mitarbeitenden: Awareness-Trainings zum datenschutzkonformen Umgang mit Copilot, einschließlich der Frage, welche Daten nicht in KI-Prompts eingegeben werden sollten

Fazit: Ihr Weg zum sicheren Copilot Einsatz

Microsoft 365 Copilot bietet durch Tenant-Isolation, den Ausschluss von KI-Training mit Kundendaten und die EU Data Boundary ein solides Datenschutzfundament. Die Verantwortung für die korrekte Konfiguration – von Berechtigungsstrukturen über Sensitivity Labels bis hin zu Conditional Access Richtlinien – liegt jedoch beim Unternehmen selbst. Ohne eine saubere IT Umgebung kann auch die sicherste KI keine Datenschutzlücken schließen, die in Ihrer Infrastruktur bereits bestehen.

Die entscheidende Frage lautet daher nicht ob Copilot sicher ist, sondern ob Ihre Umgebung bereit ist.

Sind Sie bereit für Microsoft Copilot?

Nutzen Sie unseren Copilot Readiness Check, um Ihre Microsoft 365 Umgebung systematisch auf Datenschutz, Berechtigungen, Compliance und Sicherheit zu prüfen – bevor Copilot live geht.

Kontaktieren Sie uns jetzt